昨年末、Chat GPTが私たちの生活に登場し、私たちの知っている世界を変えました。それ以来、良くも悪くも職場に革命をもたらすとされる新しいツールのニュースが毎日のように飛び込んできます。テクノロジーの進歩による初期の混乱の多くは、知識産業以外の分野で起こりましたが、今回のテクノロジーの進歩の波、つまり様々な形の人工知能(AI)は、アカデミアを含む知識産業の分野にも影響を及ぼしています。AIがプロセスに革命を起こし、効率を高め、精度を向上させる可能性は否定できません。

学術論文の執筆と編集の分野において、AIの影響力は高く、研究者の作業を効率化するだけでなく、創作を支援するさまざまなツールも提供しています。ただし、学術論文の執筆におけるAIの利用には、複雑な面がないわけではありません。AIは、文法、句読点、書式などの技術的な面を支援することはできますが、人間の研究者が研究にもたらす微妙な理解、批判的思考、独自の視点を再現することはできません。これは、文章の「ヒューマンタッチ(人間味)」と呼ばれる、人間が執筆したコンテンツ固有の理解の深さ、文脈の繊細さ、創造性を要約したものです。この人間味があるからこそ、学術文書は技術的に正しいだけでなく、意義深く、関連性があり、影響力のあるものになるのです。

多くの研究者にとって、研究、執筆、教育、生活をAIツールが両立させてくれるように思えるかもしれませんが、それほど単純なことではありません。倫理から誠実さまで、著作権からバイアスまで、さまざまな問題が絡んできます。研究者がAIによる学術論文執筆の進化する状況をナビゲートするためには、これらを理解し、AIを使うことと自分で行うことのバランスを取ることが極めて重要になります。

私たちが目指すべきは、AIを使って負担を軽くすることと、自分自身の知性で知識の限界を押し広げることのバランスをどのようにとるかを理解することです。これには、AI全般、特にツールの長所を理解すること、そして時間があれば何ができるかを理解することが必要です。インパクトのある研究を考え抜くためには、AIの能力を活用することと、学術論文に不可欠な人間味を残すことの間でバランスを取る必要があります。この記事は、そのためのロードマップとして、AIが学術論文の執筆にどのように適合するのかを掘り下げ、そのメリットとデメリットを検証し、賢明かつ責任を持ってAIを導入することの意義を強調します。

支援型AIと生成型AI

学術論文執筆に使用されるAIには、「支援型AI」と「生成型AI」という大きく2種類があります。「支援型AI」は、その名が示すように、執筆プロセスを支援しますが、「オリジナル」のコンテンツを作成するわけではありません。一方、「生成型AI」は、オリジナルのようなコンテンツを生成することができます。

Paperpalのような支援型AIツールは、学術翻訳、リサーチライティング、適切な言い換え、ジャーナルへの投稿チェックなどのタスクで研究者を支援することを目的としています。既存のコンテンツを強化するために広く使われていますが、プロンプトに基づいて新しいコンテンツを作成するわけではありません。支援型AIツールのもう1つの例としてはTurnitinが挙げられます。Turnitinは多くの大学の学部で使用されており、管理者が剽窃の事例を検出することを可能にしています。

一方、「生成型AI(GenAI)」は、画像、動画、音声、テキスト、3Dモデルなど、さまざまなデータを作成できる人工知能の一種です。これは、既存のデータからパターンを学習し、その知識を使用して新しくユニークな出力を生成することによって行われます。生成型AIは、人間の創造性を模倣した非常にリアルで複雑なコンテンツを生成することができ、ゲーム、エンターテインメント、製品デザインなど多くの業界にとって貴重なツールとなっています。

つまり、ChatGPTのような生成型AIツールは、オリジナルのコンテンツを生成することができるというわけです。高度な機械学習アルゴリズムを活用し、人間の文章を模倣したテキストを生成します。ただし、これらAIの学術論文における使用は論争を引き起こしています。これらのツールは質の高い文章を作成できる一方で、文脈や文化的なニュアンス、人間の言葉の機微を理解する能力に欠けているからです。

生成型AIの倫理、バイアス、著作権への影響を解明する

学術論文の執筆における生成型AIの使用は、いくつかの倫理的・法的考察をもたらします。これらのツールは執筆プロセスの効率化に役立つ一方で、作成されたものの信憑性や独創性についての懸念があります。学術論文は、単に事実を提示だけでなく、その分野に新しいアイデアや視点をもたらすことが重要です。論文の大部分がAIによって「共同執筆」された場合、著者と提示されたアイデアの信頼性について疑問が生じます。Nature、Elsevier、Scienceなどの主要学術出版社は、AIを論文の著者として記載することはできないと明言しています。NatureはGPTを「透明性のある科学への脅威」とまで表現しています。

次の大きな問題はバイアスです。画像を作成するAIに “early career researcher “というプロンプトを与えると、ほとんどの場合、白人男性が表示されます。AIにおけるバイアスは、よく知られている問題です。AIモデルはトレーニングの対象となるデータから学習しますが、このデータにバイアスがかかっていると、AIは生成するコンテンツで誤ってこうしたバイアスを永続化させてしまう可能性があるのです。これは学術論文に歪んだ情報や偏った情報をもたらす可能性があり、客観性と正確性が最優先される分野では深刻な懸念事項となります。

また、学術論文における生成AIの使用は、複雑な著作権問題を引き起こします。というのも、AIチャットボットによって生成された回答の元のソースを追跡することは困難で、著作権で保護された著作物が含まれている可能性があるためです。AIが文章を生成した場合、その文章の著作権は誰に帰属するのでしょうか? AIツールを使用した研究者、AIの開発者、あるいはAIそのもの? 現在のところ、世界中の著作権法はこのような問題に対応できるようにはなっておらず、法的にはグレーゾーンとなっています。

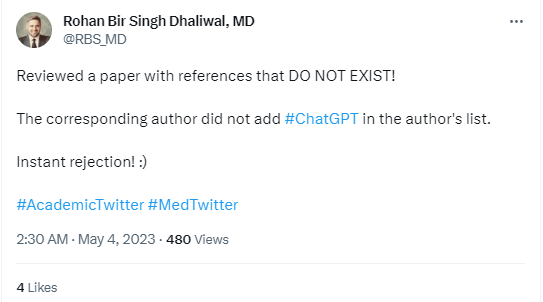

最後に、「ハルシネーション(hallucination)」の問題です。ChatGPTのようなAIモデルの既知の問題のひとつは、「ハルシネーション」、つまり、もっともらしく見えるが事実に基づいていない情報を生成する傾向があることです。これは、たとえAIモデルが膨大な量のデータに基づいてトレーニングされていても、世界を正しく理解したり、リアルタイムの情報にアクセスしたりすることができないためです。AIは学習したパターンに基づいて文章を作り上げることが多く、その結果、真実のように聞こえる「偽の情報」を作り出すことがあります。最近、ある査読者が、ある論文をリジェクトせざるを得なかった理由について語りました。

この特性は、正確さと事実の正しさが最優先される学術論文において、大きな課題となります。

支援型AIの使用における倫理的考慮事項

支援型AIは一般的に、生成型AIほど議論の対象とはなりませんが、それでも留意すべき倫理的な考慮点がいくつかあります。これらのツールはサービスを提供するために、作成された文章へのアクセスを必要とすることが多いため、データのプライバシーは大きな懸念事項です。そのため、データのプライバシーや機密性に関する疑問が生じます。

また、支援型AIに過度に依存することで、人間の文章作成スキルが低下するリスクもあります。これらのツールは非常に役に立ちますが、理想的には、強力なライティングスキルの「代わり」ではなく、それを「補うもの」として使用されるべきです。

さらに、すべての研究者が同じAIツールを利用できるわけではないので、研究論文の質に格差が生じる可能性もあります。これはどちらかというと体系的な問題ですが、学術論文におけるAIに関するより広範な議論において、倫理的に重要な検討事項です。

最後に、生成型AIと同様に、支援型AIもバイアスがかかりやすい可能性があります。これらのツールが提供する文法や文体の提案は、特定の基準や規範に基づいており、すべての文体や方言を網羅しているとは限りません。そのため、文体の均一化や、特定の方言や非標準的な言語の疎外につながる可能性があります。

学術論文における人間味

AIには多くの利点がありますが、人間の研究者と比較した場合のAIの限界を見落としてはなりません。AIはライティングの様々な側面を支援することはできますが、研究者が本来持っている高度な知識や理解力には欠けています。人間の研究者は、言語のニュアンスを深く理解し、複雑なアイデアを把握する能力があり、特定の研究分野内で論文の論旨が論理的で一貫性があり、影響力のあるものであることを保証する専門知識を持っています。さらに、研究者は自分の研究に現状のAIでは再現できない独自の視点や声を組み込んでいます。例えば、革新的な仮説を発表したり、画期的な研究を行ったりするとき、人間の研究者の批判的思考や直感は、科学的発見を前進させる上で重要な役割を果たします。

AIの責任ある利用

AIを研究執筆のワークフローに組み込む際には、責任ある利用が不可欠です。AIは人間の専門知識に代わるものではなく、研究者のスキルを強化し、補完する貴重なツールとして捉えるべきです。文法や書式のチェックなどの繰り返し作業をAIに任せることで、研究者は執筆プロセスの重要で複雑な側面に、より多くの時間とエネルギーを費やすことができます。例えば、AIはデータ分析、文献レビュー、引用文献の管理などのタスクを支援し、研究者はデータの解釈をより深く掘り下げ、斬新な洞察を開発し、説得力のある議論を構築できます。AIと研究者の役割分担を最適化することで、執筆プロセスはより効率的になり、研究者は学術的言説を形成する、より高度な知的貢献に集中することができるのです。

結論

結論として、AIは執筆プロセスにおいて研究者に数多くのメリットをもたらしますが、研究者がもたらす専門知識、批判的思考、ニュアンスをふまえた理解に取って代わることはできません。アカデミック・ライティングの未来は、AIと人間によるインプットが、それぞれの強みを発揮する、バランスの取れたアプローチにあります。この相乗効果により、ミスがないだけでなく、内容や文脈に優れた質の高い学術論文が作成できるでしょう。

この記事はEditage Insights 英語版に掲載されていた記事の翻訳です。Editage Insights ではこの他にも学術研究と学術出版に関する膨大な無料リソースを提供していますのでこちらもぜひご覧ください。