人工知能(AI)ツールは、学術論文やクリエイティブな執筆のさまざまな段階で、コンテンツの編集、フォーマット、修正、さらには作成に使用することができます。生成AIは、テキスト、画像、その他のメディア、合成データを作成できます。現在、OpenAIのGPT、GoogleのBard、MetaのLlamaなど、複数の生成AIツールが存在します。GPTにはさまざまなバージョンがあり、そのひとつがChatGPTとして広く知られているGPT-3.5です。

AIモデルは優れた執筆ツールとなり得ますが、Springer Nature、Elsevier、Taylor & Francis、JAMA、MDPIなどを含むほとんどの科学ジャーナル出版社は、AIが著者になることを排除しています1-5。その背景にある主な懸念は、著者に求められる責任です。AI ツールは必ずしも内容に対して責任を負う資格があるわけではありません。AIツールを使用する場合、ほとんどの出版社は論文内にAIの使用について適切に記載するよう求めます。また、生成AIツールによって作成された画像は、論文に使用すべきではないとも述べています。ただし、非生成AIベースの画像や、場合によっては生成AIベースの画像も、生成 AI の使用をある程度まで適切に開示した上で、ケースバイケースで検討されます1。

2023年3月に行なわれたJournal of Product Innovation Managementの編集者への調査では、ほとんどの人がAIが著者であることに同意しませんでしたが、なかには同意する人もいれば、はっきりとした答えがない人もいました6。他のジャーナルでも同様の見解が共有されれば、将来、生成AIに関する著者規則に何らかの変更が発生する可能性があります。

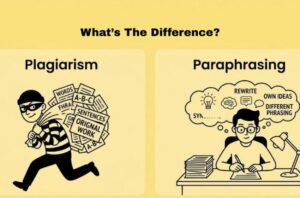

ライティングにおけるAIツールの使用に関する重大な懸念の一つは、プロンプトで提供される情報の機密性に関するものです。ほとんどのAIツールは、プロンプトに含まれる情報を保存し、これらをAIモデルのトレーニング材料として使用します。そのため、職場でのAIツールの使用を禁止している企業もあります7。つい最近、OpenAIは、ユーザーが入力した情報によってChatGPTをトレーニングすることを無効にするポリシーを開発しました。Hacks/Hackersの機械学習エンジニアでAI研究員のSil Hamilton氏は、Knight Center主催のウェビナーで、「機密情報、つまり人に読まれたくない情報がある場合、それをこれらのモデルに入れないでください」と述べています8。

また、Elsevierなどの一部の出版社は、秘密保持、プライバシー、所有権を侵害する可能性があるため、論文のいかなる部分も生成AIツールにアップロードしないように指示しています2。

簡単に言えば、AIの言語モデルは「知識ベース」と「言語ベース」の2つの部分に分かれています。おすすめは言語ベースだけを使用することです。ユーザーが知識ベースにアクセスしようとすると、モデルが間違った情報を生成する可能性があります。これは通常「ハルシネーション」によるものです。「ハルシネーションとは、AIモデルが持っている知識を少し超えて拡張するときに発生します。たとえば、GPTの知識に空白がある場合、ある方法や別の方法で何かが関連していることを理解できず、可能性のある方法を考え出そうとしてしまうのです」とHamilton氏は言います8,9。このような問題は、AIツールを使ったコンテンツ作成を避け、使用する場合はAIが生成したコンテンツの事実確認を徹底することで解決することができます7。

テキストと同様に、生成AIツールは画像や動画を作成することもできます。といっても、AIツールは画像や動画の生成についてはまだ完成度が低いため、AIによって生成された画像や動画を他のものと見分けるのは簡単です。ただし、AIによって生成されたテキストを識別することはますます難しくなってきています。専門家の見解はさまざまで、AIが生成したコンテンツを識別する方法を見つけることに期待する人もいますが、未来に進めば進むほど、現在の測定基準ではAIが生成したコンテンツを識別できる可能性は低くなるだろうという意見もあります。完全に確実な解決策ではありませんが、AIが生成したコンテンツに電子透かしを入れることは、専門家の関心を集めています。この分野は今後も進化し続けるため、AI によって生成されたコンテンツを区別するのは常に困難になる可能性があります8,10。

AIが著者になることやコンテンツ作成におけるAIの使用については否定的な立場にもかかわらず、ほとんどの出版社は適切な開示を行った上で、著者が AI ツールを使用して論文の言語と簡潔さを改善することを許可しています。これは、論文が書かれた言語を母国語としない人にとって非常に役立ち、単語数を減らすのにも役立ちます。

編集や推敲以外にも、AIツールを使うことにはいくつかの利点があります。これらのモデルは、文章が提供されれば、徹底的な要約を生成することができます。また、出版物の種類に特化したアウトラインの構成を支援したり、著者がジャンルに不慣れな場合に、特定の種類の文章の例文を作成することもできます。また、テキストの一部をある言語から別の言語に翻訳することもできます9,11。

ChatGPTのように検索バーにプロンプトを入力するだけでなく、特定のAIツールでは文書をアップロードすることもできます。ChatPDFやAnthropicでPDF文書をアップロードし、文書から情報を検索してみることができます。このようなオプションは、研究論文の特定の情報を検索する際に非常に役立ちます。論文をアップロードして適切な質問をするだけで、費やす時間を大幅に短縮することができます。

最後に、学術論文でAIを活用する際のチェックリストとして、以下を参考にしてください。

●AIを使用したことを明記する: ChatGPTなどのAIツールを使用する場合は、透明性を優先するために、他のソフトウェアの場合と同様に、論文内でその使用方法を明確に記載します。

●AIを著者とすることを避ける: 説明責任の観点から、ほとんどのジャーナルはAIを著者として認めていません。

●機密保持: トレーニングのためにプロンプトが保存される可能性があるため、AIモデルに機密情報を入力することは避ける。

●AIが生成したコンテンツのファクトチェック: AIツールによって作成されたコンテンツを検証し、可能な限りコンテンツの生成を避けます。

●言語と簡潔さを強化: AIツールの最も良い使い方の1つは、言語の質とテキストの流れを改善することであり、特に非ネイティブ スピーカーにとって役立ちます。

●要約にAIを活用する: AIモデルは、包括的な要約を生成し、さまざまな執筆ジャンルのアウトラインを構造化するのに役立ちます。

●AIによる文書検索:一部のAIツールでは、情報を取得するために文書をアップロードすることができます。PDFを分析することで、調査を迅速化できる。

●ガイドラインの最新情報を入手する: AIツールは進化し続けているため、出版社からのガイドラインの変更に関する情報を常に入手しましょう。

参考文献

2. Publishing ethics | Elsevier policy. beta.elsevier.com https://beta.elsevier.com/about/policies-and-standards/publishing-ethics.

3. Flanagin, A., Kendall-Taylor, J. & Bibbins-Domingo, K. Guidance for Authors, Peer Reviewers, and Editors on Use of AI, Language Models, and Chatbots. JAMA 330, 702–703 (2023).

5. Robinson, M. Taylor & Francis Clarifies the Responsible use of AI Tools in Academic Content Creation. Taylor & Francis Newsroom https://newsroom.taylorandfrancisgroup.com/taylor-francis-clarifies-the-responsible-use-of-ai-tools-in-academic-content-creation/ (2023).

7. Writing the rules in AI-assisted writing. Nat Mach Intell 5, 469–469 (2023).

8. Generative AI: What journalists need to know about ChatGPT and other tools. (2023).

9. The synergy of human expertise and AI: Maximizing academic writing efficiency and impact. Editage Insights https://www.editage.com/insights/the-synergy-of-human-expertise-and-ai-maximizing-academic-writing-efficiency-and-impact (2023).

10. Tools such as ChatGPT threaten transparent science; here are our ground rules for their use. Nature 613, 612–612 (2023).

11. Generative AI in Academic Writing. The Writing Center • University of North Carolina at Chapel Hill https://writingcenter.unc.edu/tips-and-tools/generative-ai-in-academic-writing/.

この記事はEditage Insights 英語版に掲載されていた記事の翻訳です。Editage Insights ではこの他にも学術研究と学術出版に関する膨大な無料リソースを提供していますのでこちらもぜひご覧ください。