「ChatGPTを使って研究論文を執筆することはできますか?」

この問いは、いま研究コミュニティで最も頻繁に耳にする質問のひとつでしょう。急速に進化する生成AIの登場により、研究者の執筆環境は大きく変わりつつあります。ChatGPTのようなツールは、複雑な論文内容の要約、英語表現の洗練、抄録の作成、さらには文章全体の読みやすさ向上まで、これまで時間を要していた作業を効率化し新たな可能性をもたらしました。

一方で、AIが学術ワークフローに深く組み込まれるようになった今、「どこまで使ってよいのか」「誰が責任を負うのか」「オーサーシップはどう扱われるのか」といった、倫理やルールに関する疑問も避けて通れません。本記事では、ChatGPTをはじめとする生成AIを研究論文執筆に活用する際に、研究者が押さえておくべき基本的な考え方と注意点について整理していきます。

ライティング補助ツールとしてのAI

AIは、研究論文執筆プロセスにおいて強力なアシスタントになり得ます。特に、第二言語で論文を書く研究者にとっては、執筆中の行き詰まりを解消したり、考えを整理したり、文章表現を洗練させたりするうえで大きな助けとなるでしょう。たとえば、段落の意味をより明確にするための言い換えを提案させたり、考察セクションの構成例を生成させたりといった使い方は、すでに多くの研究者に活用されています。こうした用途において、AIは執筆効率と表現の質を高める実用的なツールです。

しかし忘れてはならないのは、AIは著者ではないという点です。AIは独自に仮説を立てることも、研究データを解釈することもできません。また、内容の正確性や研究倫理に対して責任を負うこともありません。AIをそのまま論文の完成原稿やセクション全体の作成に用いてしまうと、人間の知的貢献と機械生成コンテンツとの境界が曖昧になるリスクがあります。だからこそ、ChatGPTをはじめとする生成AIは、執筆パートナーではなく、あくまでライティング補助ツールとして扱うべきなのです。研究のアイデア、解釈、そして結論は、常に研究者自身のものでなければなりません。

責任あるAIの利用とは

研究論文執筆においてChatGPTをはじめとする生成AIを活用する際、重要となるのが「責任ある利用」という視点です。AIは便利なツールである一方、その使い方を誤れば、研究の信頼性や倫理性を損なう可能性もあります。

研究論文執筆におけるAIの責任ある利用は、透明性・検証・人による監督という、3つの基本原則に基づいて考える必要があります。

1.透明性

研究者は、論文作成の過程でAIの支援を利用した場合、その事実を明確に開示する必要があります。たとえば、

本論文の言語表現および明瞭性を向上させる目的で、ChatGPT(OpenAI, 2025)を使用しました。

といった簡潔な記述で、多くの出版社の要件を満たすことができます。ElsevierやSpringer Natureをはじめとする大手出版社では、すでに編集方針の中にAI利用に関する開示ガイドラインが組み込まれています。

2.検証

AIツールは、常に正確な情報を提供するとは限りません。不正確な要約を生成したり、文脈を誤って解釈したり、場合によっては存在しない参考文献を提示することもあります。そのため、AIが生成したテキストを論文に組み込む前には、徹底したレビューと事実確認が不可欠です。最終的に論文に含まれるすべての単語、引用、主張について責任を負うのは、あくまで研究者自身です。

3.人による監督

AIは「判断を下す存在」ではなく、「提案を行うアシスタント」として位置づけるべきです。文章表現を洗練させることはできても、科学的な厳密性、倫理的コンプライアンス、研究成果の新規性を評価することはできません。だからこそ、AIの提案を鵜呑みにせず、常に批判的な人間の判断を介在させることが不可欠です。

出版社の対応状況

学術出版界はAI利用に関する姿勢を積極的に進化させています。多くのジャーナルでは、編集や言語改善を目的としたAI利用を認める一方、科学的コンテンツの生成や分析への使用は厳しく禁止しています。出版倫理委員会(COPE)も、完全に透明性をもってAIの貢献を謝辞に明記するよう推奨しています。統一基準はまだ存在しないものの、共通のメッセージは明確です。AIは研究コミュニケーションをサポートできますが、説明責任と著作としての責任は人間が負うことになります。

AIリテラシーを備えた研究文化の構築

AIが学術ワークフローの中に定着しつつある今、研究者にはAIリテラシー、すなわちAIツールの「できること」と「できないこと」の両方を正しく理解する力がこれまで以上に求められています。この点において、大学や研究機関、出版社が果たす役割は小さくありません。倫理的なAI利用や、責任ある研究コミュニケーションに関する明確な指針を示し、教育やトレーニングの機会を提供することで、研究者が安心してAIを活用できる環境を整えることができます。

AIを適切に活用すれば、言語の壁を下げ、研究者が本来注力すべきアイデアや発見を、より明確に伝える手助けとなります。その結果、研究論文の作成プロセスはより効率的で、開かれたものになるでしょう。

しかし同時に、優れた科学の基盤である独創性、透明性、そして誠実さは、常に最優先されるべき価値です。AIはその価値を支えるための手段であって、決して代替するものではありません。研究者一人ひとりがAIの特性を理解し、責任ある形で活用していくことこそがこれからの学術研究における健全なAI共存の鍵となるのです。

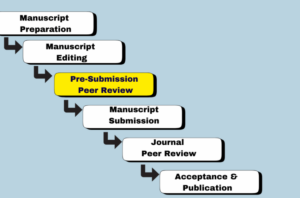

新たな形のコラボレーション

では、ChatGPTを使って研究論文を執筆することは可能なのでしょうか。適切な条件と人による十分な監督のもとであれば、AIを執筆プロセスに取り入れることは可能です。生成AIは、論文の明瞭性を高めたり、文章表現のトーンを整えたり、構成を検討する際のブレインストーミングに活用したりすることができます。一方で、それらはあくまで補助的な役割にとどまります。研究の分析、解釈、結論を導く責任は、常に研究者自身にあります。

研究論文執筆においてAIがもたらす最も大きな価値は、思考そのものを代替することではなく、思考を支え、広げ、洗練させる点にあります。AIを適切に用いることで、研究者は自らの考えをより明確に整理し、読み手に伝わりやすい形へと磨き上げることができます。

研究者が主体性と責任を保ったままAIを活用するならば、人間の洞察力と技術の利点が補完し合い、より明確で、より説得力があり、そして信頼性の高い研究成果につながるでしょう。AIは共著者ではありません。しかし、正しく位置づけられたとき、研究者にとって新たな形の協働を可能にする存在となるのです。

この記事はリサーチャーライフ(Researcher.Life)英語版に掲載されていた記事の翻訳です。リサーチャー・ライフのブログではこの他にも学術研究や学術出版に関する様々な記事が掲載されていますので、こちらもぜひご覧ください。